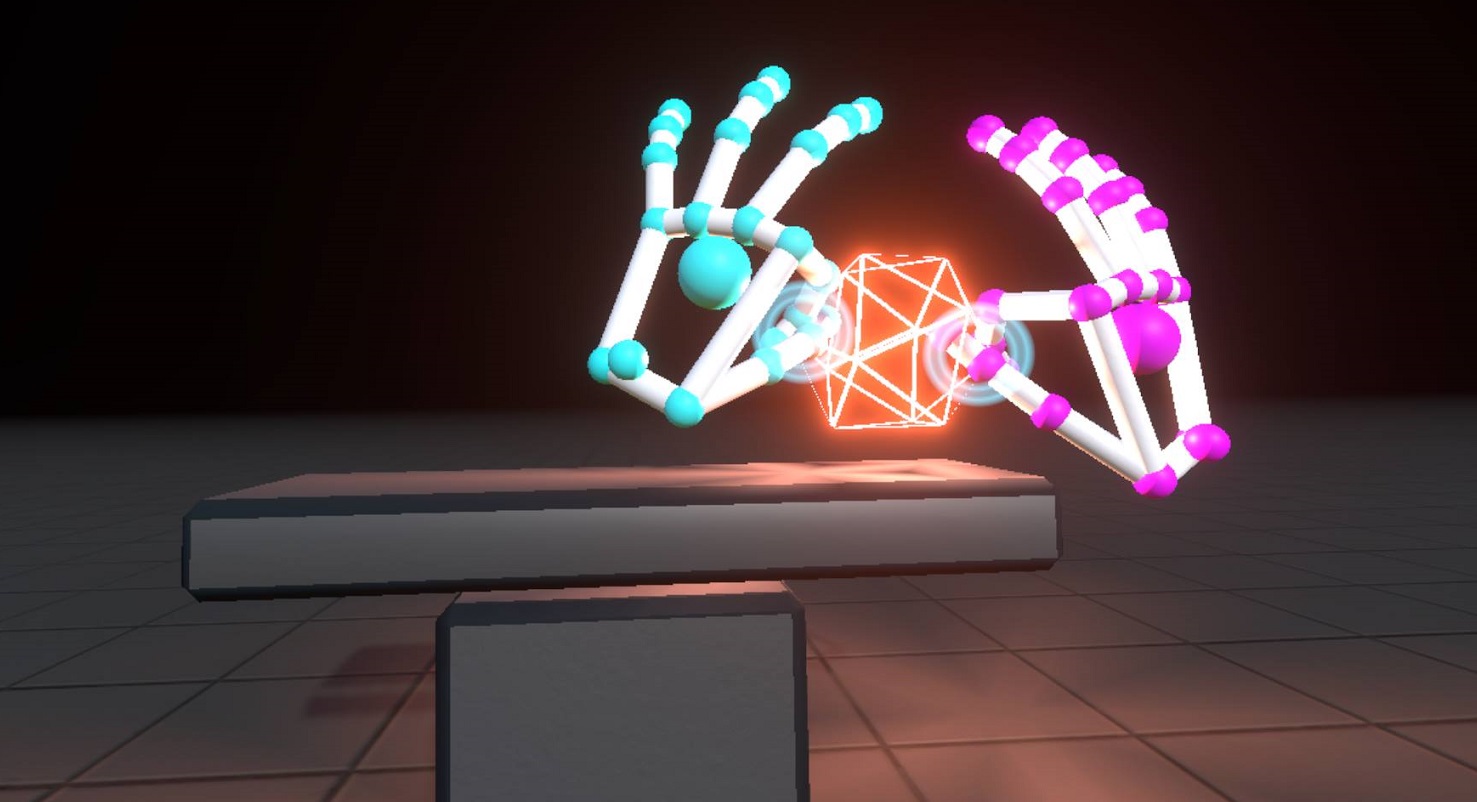

Leap Motion demonstruje zalety „Interaction Engine” – nowego silnika do lepszej interakcji z obiektami w VR.

Środowisko VR potrzebuje lepszego modułu Leap Motion. Developer dopracowuje silnik pod Unity i rozwija odczyty czujników.

Nowe technologie -> nowe problemy z interfejsami. Sprawdzone już metody standardowej interakcji z cyfrowym światem nie sprawdzają się w środowisku VR. Przenoszenie realności do sztucznego świata wymaga nowych silników działania. Właśnie dlatego platformy VR eksperymentują z komunikacją (przykładem jest Google i jego prezentacje oraz badania możliwości, które pokazano razem z projektem Daydream). Leap Motion to znana już „zabawka” do operowania rękami, ale jeszcze dopracowywana. Developerzy usprawniają właśnie swój moduł o „Interaction Engine”, czyli poprawki „czucia” trójwymiarowych obiektów.

Rzeczywistość wirtualna musi oddawać pewne odczucia w bardziej imersyjny sposób. Bawiłem się HTV Vive i jego kontrolerami i było fajnie, ale może być znacznie lepiej. Leap Motion bazuje na skanowaniu rąk, więc nie wymaga fizycznych kontrolerów. Musi być jednak odpowiednio czułe i dokładne. Element miał początkowo skupiać się na współpracy z monitorami desktopów, ale rozwój rynku zachęcił do działania z goglami VR. Żeby zwiększyć zainteresowanie czujnikami, konieczne jest usprawnienie odczytu gestów. „Interaction Engine” pokazuje efekty prac.

System jest dodatkiem do silnika Unity i obiecuje bardziej realistyczne doświadczenia w interakcji ze światem VR. Producent obiecuje efekt realnych obiektów, a kontakt z nimi ma potwierdzać właśnie przez nowy silnik. To informacje bardziej dla developerów, ale i my użytkownicy chcemy wiedzieć co w VR zmienia się na lepsze. Leap Motion przekonuje, że obecne silniki nie uwzględniają ludzkich rąk, a przecież w interakcji VR to bardzo ważne. W rzeczywistym świecie chwytamy obiekty na różne sposoby i one muszą być w VR uwzględniane.

Właśnie dlatego Leap Motion ma zaimplementować nowe reguły do środowiska VR. Operowanie przedmiotami, kontakt z nimi oraz ich podnoszenie ma być ciekawsze i bardziej naturalne. Nowe interakcje są obecnie testowane, ale raczej na małych obiektach. Od czegoś trzeba zacząć. Software ma posiadać mnóstwo opcji regulacji i dostosowania, więc programiści będą mogli nadawać różne parametry (rozróżniając rodzaje obiektów). Myślę, że to dobry moment na budowanie takich silników. Mało kto jeszcze posiada drogie gogle VR, a produkt Leap Motion jest bardzo niszowy. Producent chce, by w przyszłości jego moduł był umieszczany bezpośrednio w goglach.

Właśnie dlatego Leap Motion ma zaimplementować nowe reguły do środowiska VR. Operowanie przedmiotami, kontakt z nimi oraz ich podnoszenie ma być ciekawsze i bardziej naturalne. Nowe interakcje są obecnie testowane, ale raczej na małych obiektach. Od czegoś trzeba zacząć. Software ma posiadać mnóstwo opcji regulacji i dostosowania, więc programiści będą mogli nadawać różne parametry (rozróżniając rodzaje obiektów). Myślę, że to dobry moment na budowanie takich silników. Mało kto jeszcze posiada drogie gogle VR, a produkt Leap Motion jest bardzo niszowy. Producent chce, by w przyszłości jego moduł był umieszczany bezpośrednio w goglach.

Jakiś bezpośredni rywal dla Leap Motion? Prawdopodobnie RealSense od Intela. Jego możliwości oceny głębi również są uwzględniane przy projektowaniu oprogramowania dla VR.

źródło: Leap Motion